大家好,我是B站的UP主:我喜欢吃小熊饼干。我在CSDN会写一些文章介绍我做的项目,这些项目我都录制了详细的讲解视频(约4-6个小时的内容量),讲解基础知识,环境配置,代码使用等内容。

详细了解请移步-目标检测合集:

详细讲解视频-我喜欢吃小熊饼干的主页-哔哩哔哩视频

几分钟快速预览项目效果的演示视频:

【计算机毕设】基于深度学习的常见交通标志检测识别【YOLO】【目标检测】【Pytorch】

详细的讲解视频合集:

- 合集第一集:主要讲对整个教程的介绍,深度学习项目的基本做法和基本概念。然后介绍具体该项目的基本做法。如何去扩张项目,增加更多的内容。(这里不会涉及到代码,纯从项目的做法的角度,以PPT讲解的方式带大家入门,建立深度学习的基本概念)

- 合集第二集:毕设选题指导,毕设服务等内容

- 合集第三集:从代码使用和演示的角度,介绍项目的内容。科普深度学习环境配置的知识,如何配置项目,如何使用项目,更换数据集训练,完成特定的课题。

- 合集第四集:讲解文档相关的内容,开题报告、开题ppt、开题答辩,论文写作,论文答辩等

第一集和第三集比较重要,可以整体看下这两个视频。

下面我用文字介绍一下项目的内容

项目的背景意义:

在智慧交通体系建设与道路安全治理升级的背景下,交通标志作为传递交通规则、引导通行秩序的核心载体,其精准识别与实时感知直接关系到道路通行效率、驾驶安全与交通管理智能化水平。无论是城市道路的限速提示、路口禁令标识,还是高速公路的指路标志、警示标识,都需要在复杂路况中被快速、准确地识别,才能为交通参与者提供有效指引,降低违规行驶与交通事故风险。然而,传统交通标志检测模式依赖人工巡检、固定传感器监测等方式,存在显著局限:人工巡检效率低、覆盖范围有限,难以应对大规模路网的动态监测需求;传统传感器易受环境干扰(如暴雨、大雾、遮挡、光照变化),检测精度与实时性不足,既无法满足高动态交通场景的响应需求,也难以支撑交通管理从“事后处置”向“事前预警”的转型。

随着深度学习技术在目标检测领域的突破,YOLO 算法凭借 “单次检测、实时响应、多场景适配” 的核心优势,为交通标志检测提供了技术革新路径。其通过卷积神经网络可快速捕捉交通标志的形态特征、颜色信息与纹理细节,在复杂环境中实现对不同类型、不同尺寸交通标志的精准定位与分类,突破传统检测 “效率低、抗干扰能力弱” 的瓶颈。对于深度学习方向的毕业设计而言,基于 YOLO 的交通标志检测项目不仅是对算法原理、模型训练、数据处理等理论知识的实践转化,更承载着连接学术研究与智慧交通实际需求的重要价值。

从实践意义来看,该项目可围绕交通标志检测的核心痛点展开技术探索:例如,通过优化 YOLO 网络结构提升小尺寸、远距离交通标志的检测精度,通过数据增强技术增强算法对极端天气(暴雨、逆光)与复杂场景(多标志重叠、遮挡)的适应性,通过模型性能调优平衡检测速度与准确率,为实际交通场景提供 “精准识别 - 实时反馈 - 风险预警” 的一体化技术方案。这些探索不仅能深化对目标检测算法在特定领域应用逻辑的理解,更能培养数据标注、模型调优、性能评估的综合科研能力,为后续在计算机视觉、智慧交通等领域的深入研究奠定基础。

从行业与社会价值来看,项目成果可作为智慧交通、自动驾驶、道路安全治理的核心技术支撑:在交通管理领域,精准的交通标志检测能辅助路网监测系统实时掌握标志状态,及时发现破损、遮挡等问题,保障交通指引有效性;在自动驾驶领域,可为车辆感知系统提供关键交通规则信息,助力自动驾驶决策的安全性与合规性;在道路安全领域,能为驾驶行为分析提供数据支撑,识别未按标志行驶的违规行为,降低事故风险。此外,项目所体现的 “算法场景化适配 - 实际问题解决 - 技术落地探索” 思路,也为深度学习技术在交通领域的规模化应用提供了参考范式。

长远来看,基于 YOLO 的交通标志检测技术不仅是智慧交通体系建设的重要组成部分,更是推动道路安全治理向 “精细化、智能化” 转型的关键环节。而毕设项目作为技术探索的起点,其研究过程与成果既能为学术领域贡献实践经验,也能为交通行业的技术升级提供思路,兼具显著的学术价值、实践价值与社会价值。

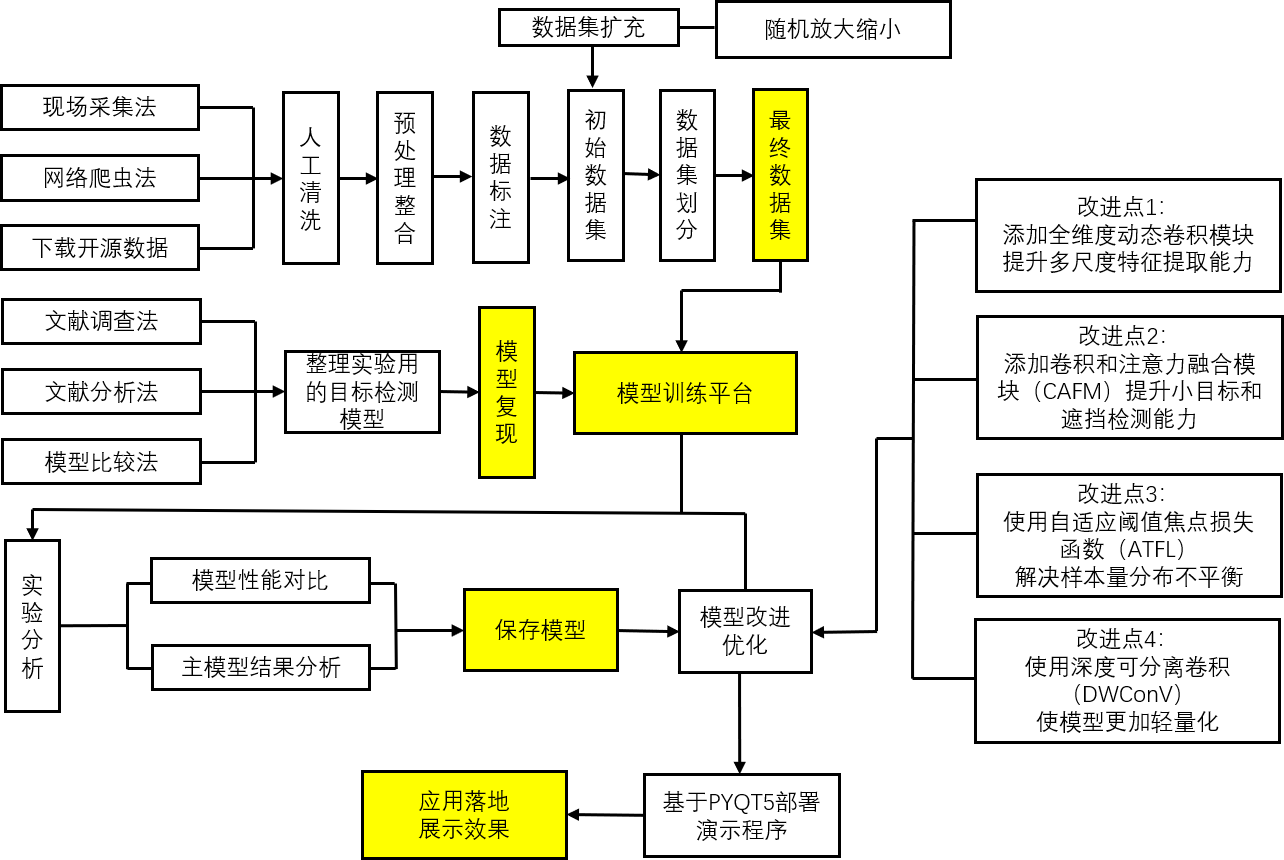

项目的技术路线图

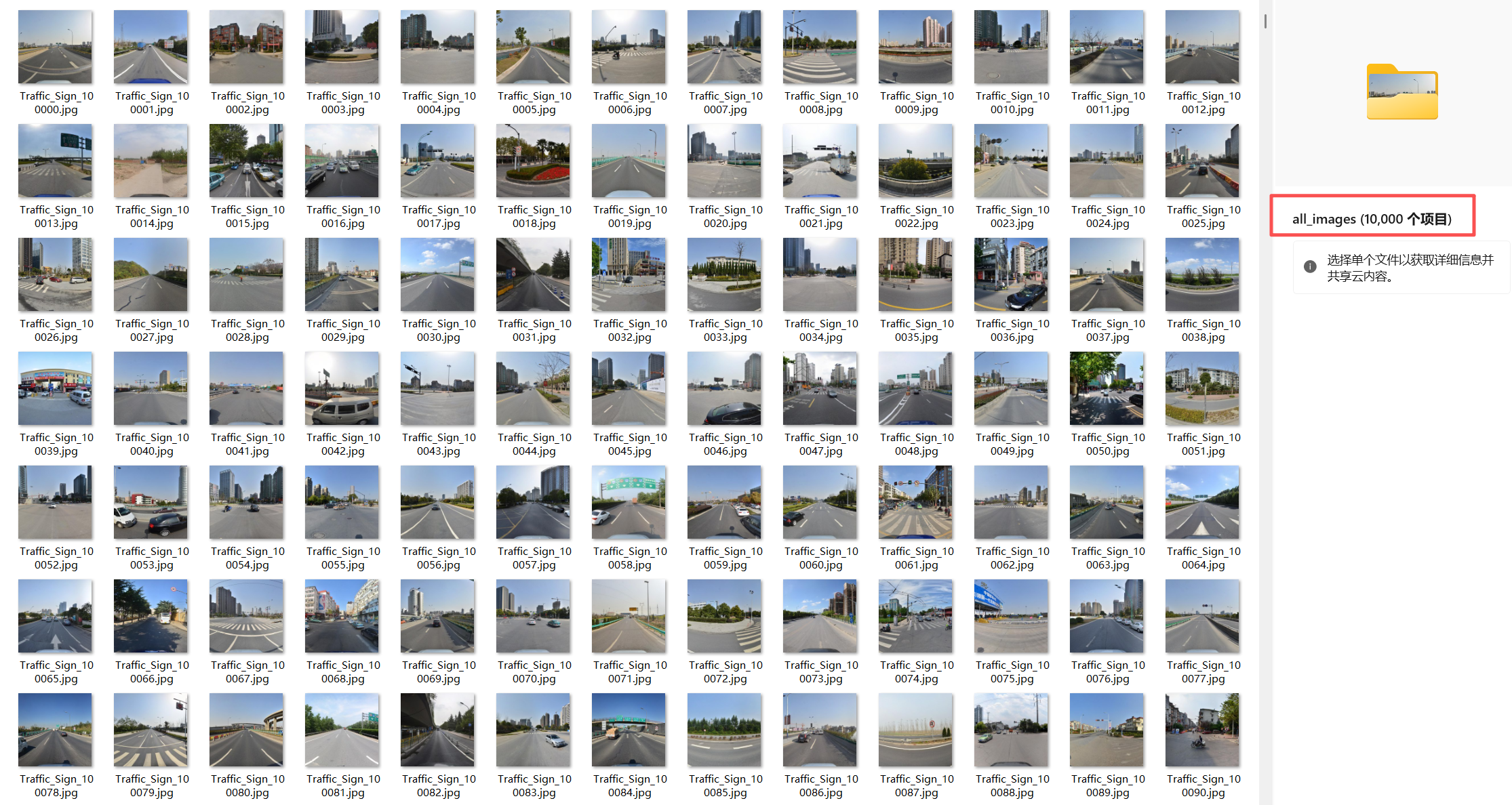

项目的数据集信息如下:

数据集图片一共有10000张图片。

TT100K(Tsinghua-Tencent 100K)是由清华大学与腾讯联合推出的交通标志检测和识别数据集。

选取TT100K数据集中,标注数量大于200的常见标注对象

类别数量: 22

pl40: 1703

p26: 882

p11: 1810

pl5: 595

pn: 3561

w57: 425

pne: 2647

i5: 1907

pl50: 1272

pl30: 732

pl80: 1089

pl60: 1039

i4: 855

i2: 513

ip: 353

pl120: 383

pl100: 860

il80: 378

il60: 633

p5: 398

p23: 290

p10: 432

标注信息详细解释:

0: pl40 Limit speed限制速度(40)

1: p26 Prohibit laden car into禁止载货汽车驶入

2: pne No Entry禁止驶入

3: i5 Keep on the right side of the road靠右侧道路行驶

4: p5 No U-turn禁止掉头

5: ip Pedestrian Crossing人行横道

6: pl30 Limit speed限制速度(30)

7: pn No parking禁止停车

8: p11 Prohibit honking禁止鸣喇叭

9: pl5 Limit speed限制速度(5)

10: i4 Motor vehicle机动车行驶

11: pl80 Limit speed限制速度(80)

12: pl50 Limit speed限制速度(50)

13: pl100 Limit speed限制速度(100)

14: il80 最低限速80

15: il60 最低限速60

16: i2 Non_motorized vehicles非机动车行驶

17: pl60 Limit speed限制速度(60)

18: pl120 Limit speed限制速度(120)

19: w57 Pay attention to pedestrians注意行人

20: p10 Limit speed限制速度(10)

21: p23 Prohibited left turn禁止向左转弯

一张图片可以有多个标注对象,所以标注数量的总和不一定是图片的总和。

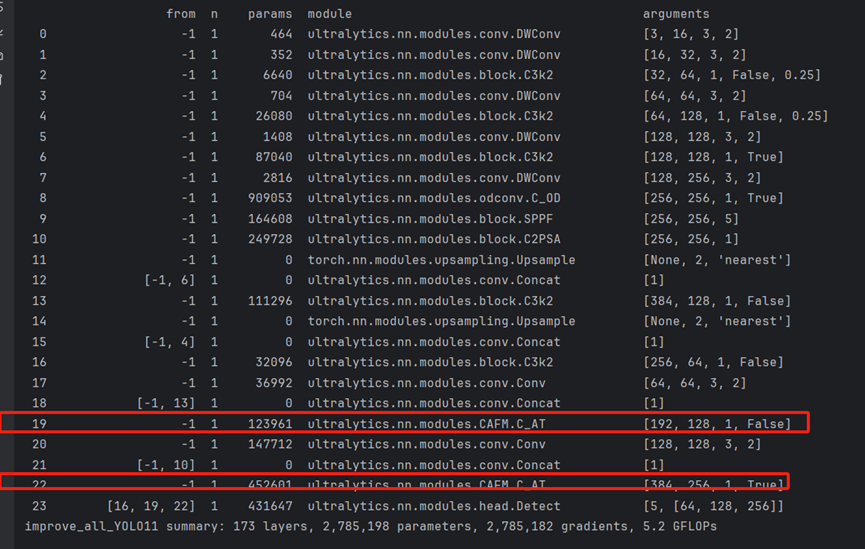

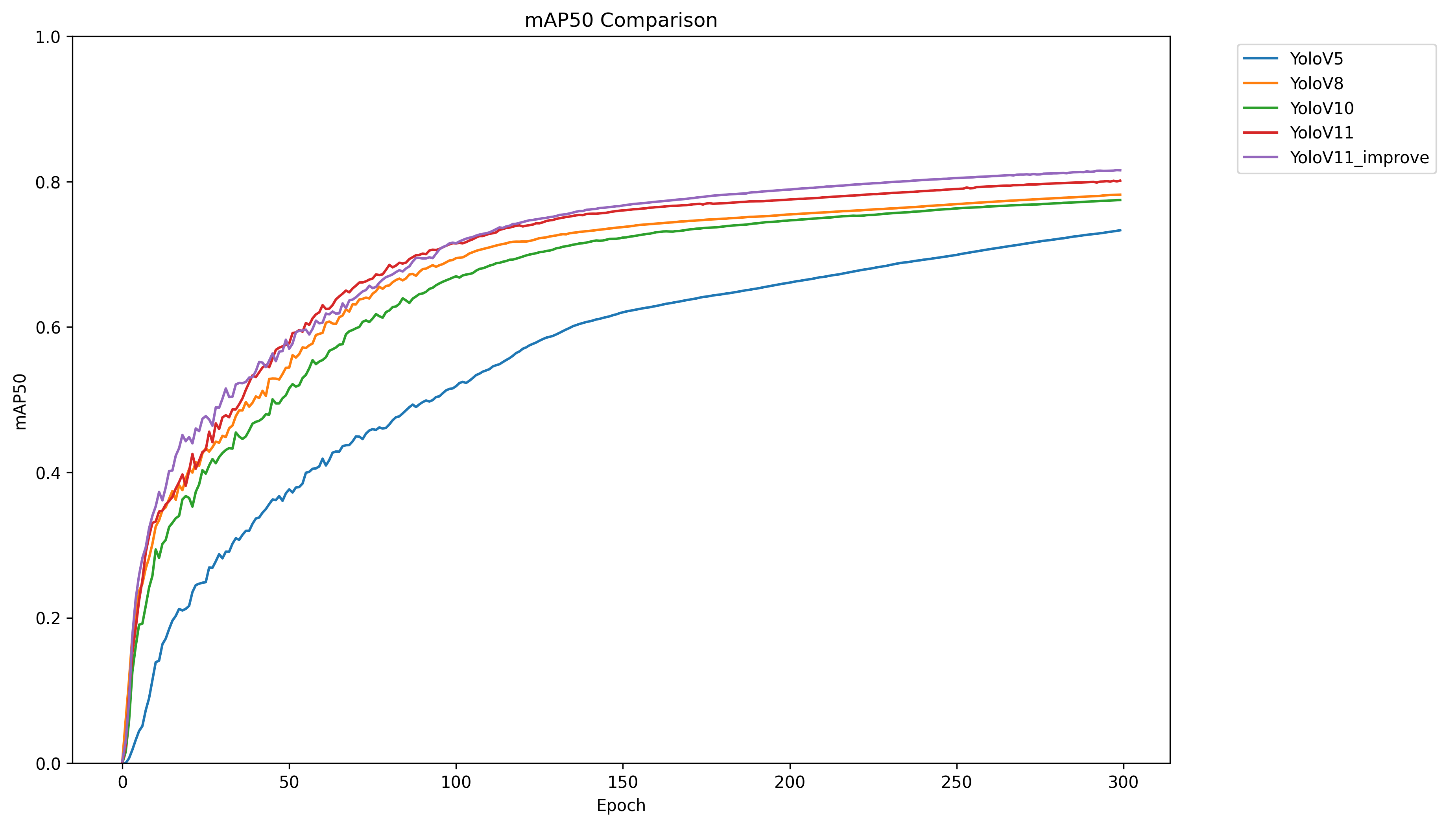

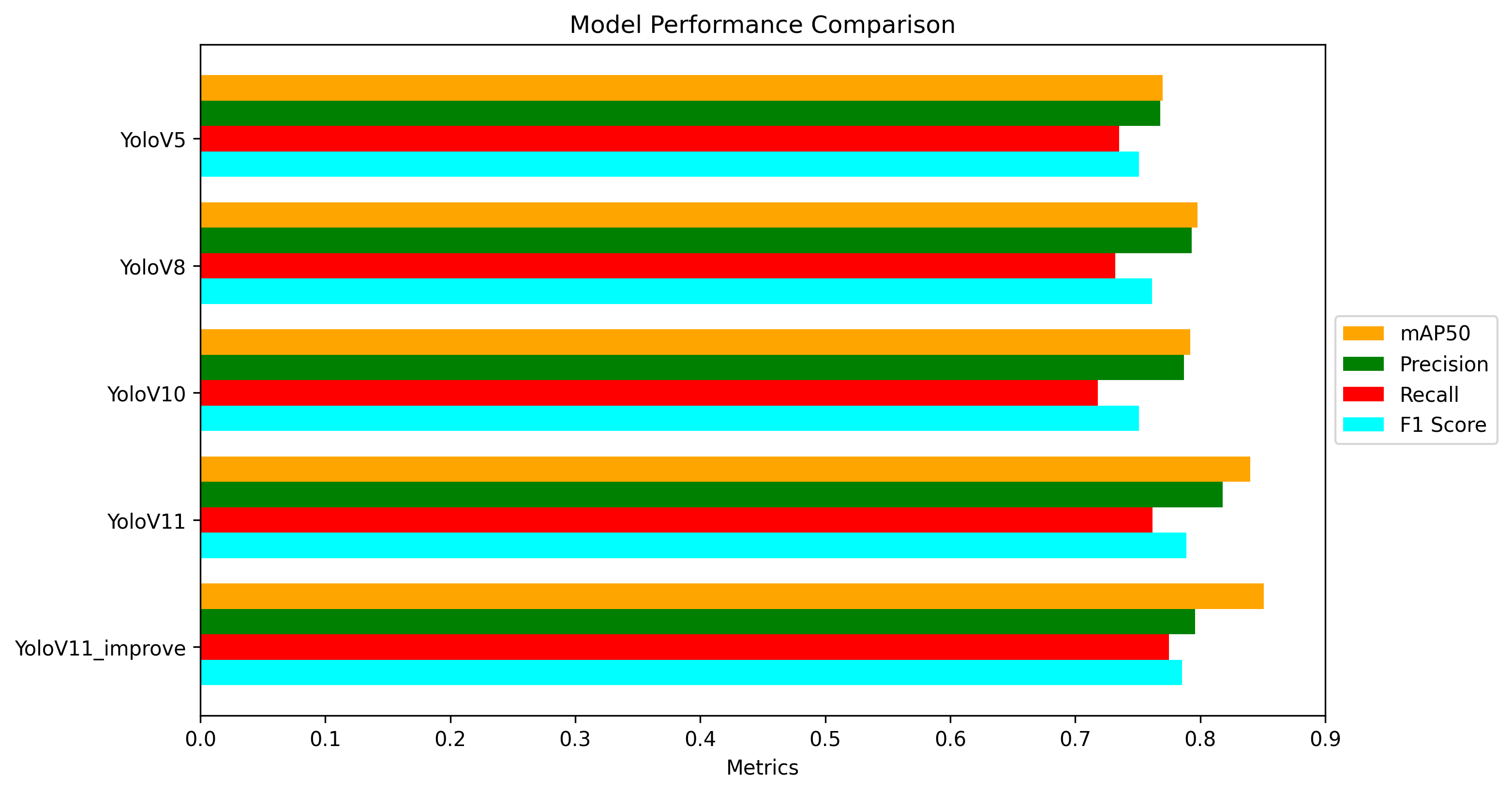

项目里实现了多种目标检测YOLO模型:

1.YOLOV5

2.YOLOV8

3.YOLOV10

4.YOLOV11

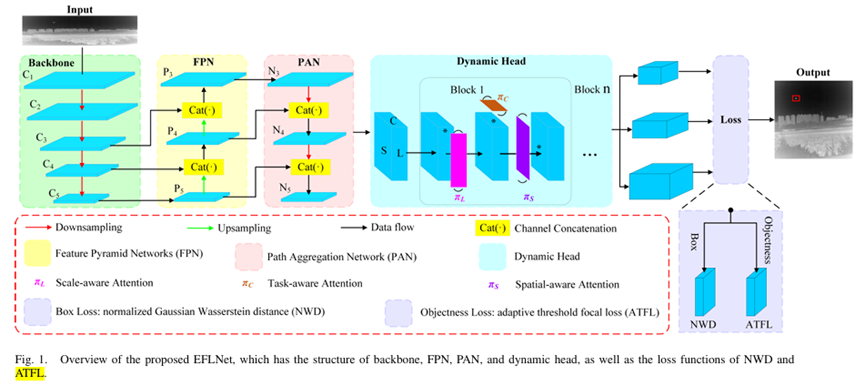

并且对YOLO模型做了优化改进

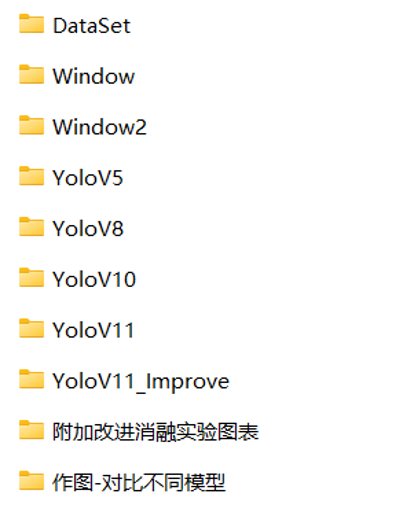

在我的设计的项目里,一般结构如下:

DateSet: 数据集相关的内容

Window:GUI演示系统

Window2:GUI演示系统

(提供了2种风格的演示系统,选择其中一种使用就行)

YOLOV5:YOLOV5模型代码

YOLOV8:YOLOV8模型代码

YOLOV10:YOLOV10模型代码

YOLOV11:YOLOV11模型代码

YOLOV11_Improve:YOLOV11模型和改进优化的内容

改进说明如下:

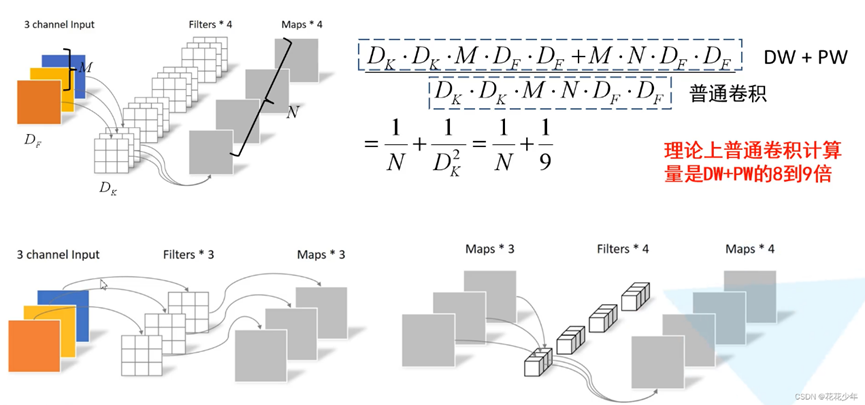

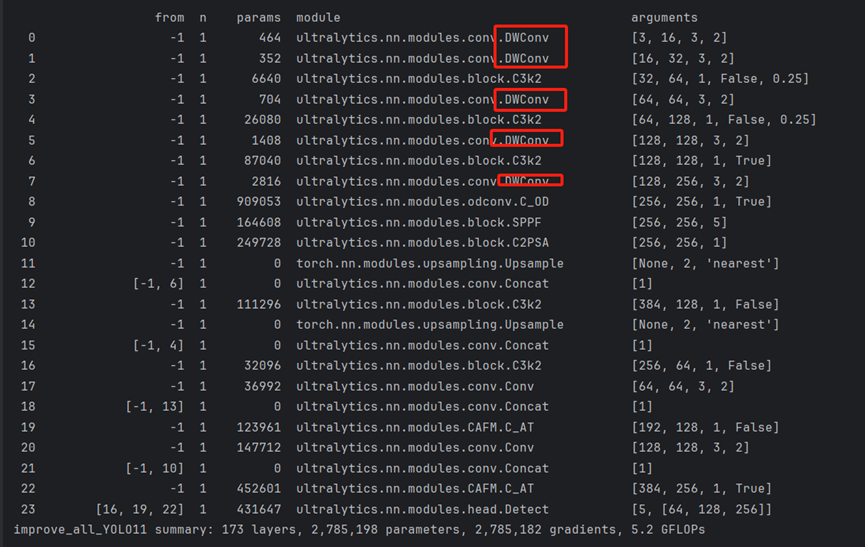

改进点1:使用深度学习可分离(DWConV)卷积代替主干网络中的传统卷积,减小参数量和计算量,使得模型轻量化。

常用的轻量化模型: MobileNet 核心就是这个

论文题目:MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications

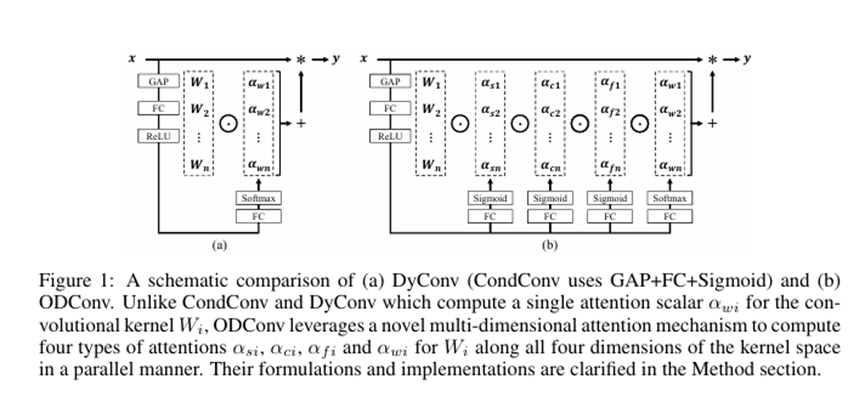

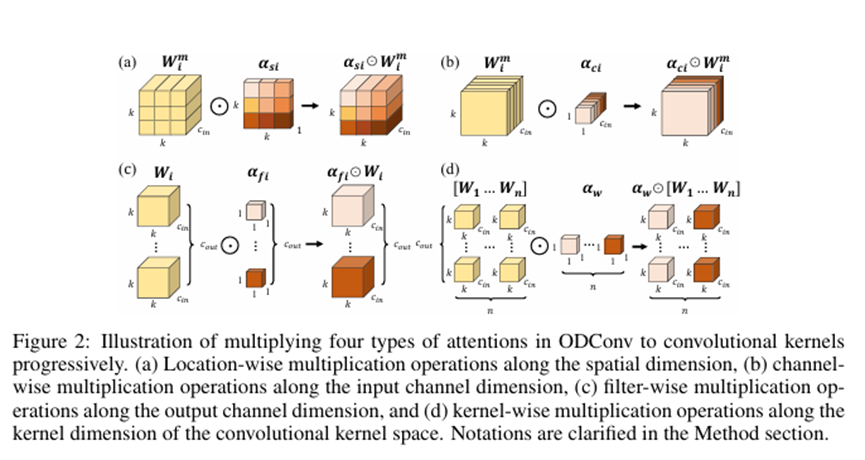

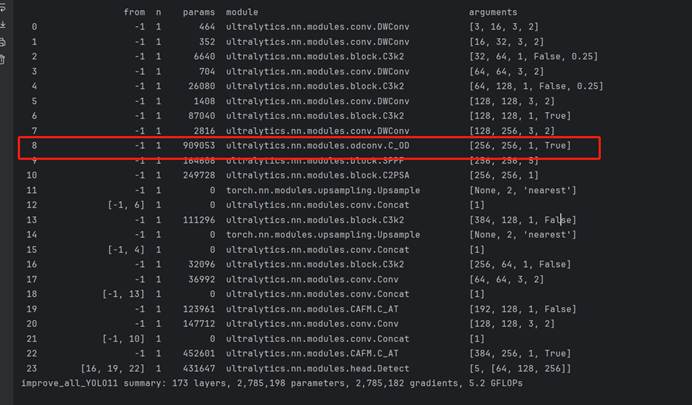

改进点2:添加全维度动态卷积模块(Omni-dimensional Dynamic Convolution,ODConv):

class ODConv2d(nn.Module):

def __init__(self, in_planes, out_planes, kernel_size, stride=1, padding=1, dilation=1, groups=1,

reduction=0.0625, kernel_num=4):

super(ODConv2d, self).__init__()

in_planes = in_planes

self.in_planes = in_planes

self.out_planes = out_planes

self.kernel_size = kernel_size

self.stride = stride

self.padding = padding

self.dilation = dilation

self.groups = groups

self.kernel_num = kernel_num

self.attention = Attention(in_planes, out_planes, kernel_size, groups=groups,

reduction=reduction, kernel_num=kernel_num)

self.weight = nn.Parameter(torch.randn(kernel_num, out_planes, in_planes // groups, kernel_size, kernel_size),

requires_grad=True)

self._initialize_weights()

if self.kernel_size == 1 and self.kernel_num == 1:

self._forward_impl = self._forward_impl_pw1x

else:

self._forward_impl = self._forward_impl_common

def _initialize_weights(self):

for i in range(self.kernel_num):

nn.init.kaiming_normal_(self.weight[i], mode='fan_out', nonlinearity='relu')

def update_temperature(self, temperature):

self.attention.update_temperature(temperature)

def _forward_impl_common(self, x):

# Multiplying channel attention (or filter attention) to weights and feature maps are equivalent,

# while we observe that when using the latter method the models will run faster with less gpu memory cost.

channel_attention, filter_attention, spatial_attention, kernel_attention = self.attention(x)

batch_size, in_planes, height, width = x.size()

x = x * channel_attention

x = x.reshape(1, -1, height, width)

aggregate_weight = spatial_attention * kernel_attention * self.weight.unsqueeze(dim=0)

aggregate_weight = torch.sum(aggregate_weight, dim=1).view(

[-1, self.in_planes // self.groups, self.kernel_size, self.kernel_size])

output = F.conv2d(x, weight=aggregate_weight, bias=None, stride=self.stride, padding=self.padding,

dilation=self.dilation, groups=self.groups * batch_size)

output = output.view(batch_size, self.out_planes, output.size(-2), output.size(-1))

output = output * filter_attention

return output

def _forward_impl_pw1x(self, x):

channel_attention, filter_attention, spatial_attention, kernel_attention = self.attention(x)

x = x * channel_attention

output = F.conv2d(x, weight=self.weight.squeeze(dim=0), bias=None, stride=self.stride, padding=self.padding,

dilation=self.dilation, groups=self.groups)

output = output * filter_attention

return output

def forward(self, x):

return self._forward_impl(x)全维度动态卷积(Omni-dimensional Dynamic Convolution,ODConv)算法是一种新型的卷积神经网络(CNN)架构。它通过动态调整卷积核的形状和大小,以适应不同的输入数据维度,从而提高模型的灵活性和性能。

灵活性:ODConv能够根据输入数据的维度动态调整卷积核,使得模型能够处理不同形状和大小的输入数据。

性能提升:通过动态调整卷积核,ODConv能够更好地捕捉输入数据的特征,从而提高模型的性能。

在配置文件中,用C_OD代替原来的C3k2,实现全维度动态卷积(Omni-dimensional Dynamic Convolution,ODConv)代替原来的传统卷积模块

总结:结合具体的检测场景去写,如果说场景里面有明显小目标的,可以倾向于写提升小目标特征提取能力,如果没有明显的小目标的,可以说提升模型的多尺度特征提取能力。

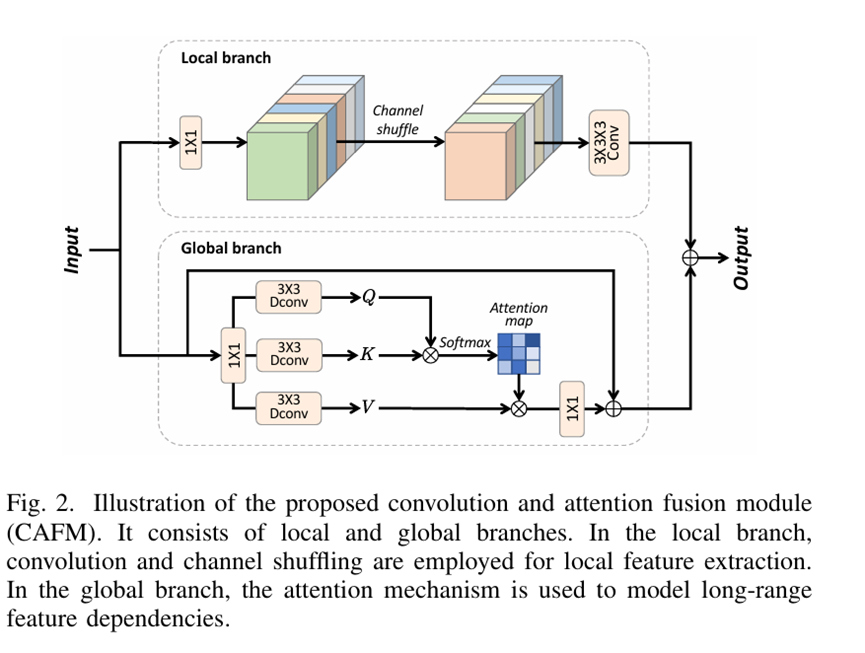

改进点3:添加卷积和注意力融合模块(CAFM)提升小目标和遮挡检测能力

CAFM 旨在融合卷积神经网络(CNNs)和 Transformer 的优势,通过结合局部特征捕捉能力(卷积操作)和全局特征提取能力(注意力机制),对图像的全局和局部特征进行有效建模,以提升检测效果。

在配置文件中,主干网络部分:用C_AT 代替原来的C3k2:

总结:

增强特征提取:通过结合卷积操作和注意力机制,CAFM能够有效捕捉局部和全局信息。卷积操作擅长处理局部特征,而注意力机制则善于建模全局信息。

改进信息嵌入:CAFM可以高效地在输入数据的不同部分之间进行信息嵌入和特征融合,从而对输入特征有更全面的理解。(提升遮挡检测的能力)

双向信息流:CAFM构建了双向信息流桥梁,允许输入数据的不同部分之间进行信息嵌入和特征融合,增强了模型的整体性能。

可以往,场景中目标存在一些遮挡的情况,往提升遮挡情况下的性能,这方面编。(如果没有遮挡,就直接说它提升模型的特征融合能力,增强性能)

class Bottleneck_AT(nn.Module):

"""Standard bottleneck."""

def __init__(self, c1, c2, shortcut=True, g=1, k=(3, 3), e=0.5):

"""Initializes a standard bottleneck module with optional shortcut connection and configurable parameters."""

super().__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Attention(c1)

self.cv2 = Conv(c_, c2, k[1], 1, g=g)

self.add = shortcut and c1 == c2

def forward(self, x):

"""Applies the YOLO FPN to input data."""

return x + self.cv2(self.cv1(x)) if self.add else self.cv2(self.cv1(x))

class C_AT(nn.Module):

"""Faster Implementation of CSP Bottleneck with 2 convolutions."""

def __init__(self, c1, c2, n=1, shortcut=False, g=1, e=0.5):

"""Initializes a CSP bottleneck with 2 convolutions and n Bottleneck blocks for faster processing."""

super().__init__()

self.c = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, 2 * self.c, 1, 1)

self.cv2 = Conv((2 + n) * self.c, c2, 1) # optional act=FReLU(c2)

self.m = nn.ModuleList(Bottleneck_AT(self.c, self.c, shortcut, g, k=((3, 3), (3, 3)), e=1.0) for _ in range(n))

def forward(self, x):

"""Forward pass through C2f layer."""

y = list(self.cv1(x).chunk(2, 1))

y.extend(m(y[-1]) for m in self.m)

return self.cv2(torch.cat(y, 1))

def forward_split(self, x):

"""Forward pass using split() instead of chunk()."""

y = list(self.cv1(x).split((self.c, self.c), 1))

y.extend(m(y[-1]) for m in self.m)

return self.cv2(torch.cat(y, 1))改进点4:使用自适应阈值焦点损失(ATFL)函数

自适应阈值焦点损失(ATFL)是一种动态调整损失权重的损失函数,旨在通过降低易分类样本的影响,增强对难分类样本的关注,从而提升目标检测和分割任务中的模型性能。

在类别不平衡的情况下,比较有效。

ATFL 主要有以下几个特点:

自适应性:ATFL 根据每个样本的特征和模型的输出自适应地调整损失权重。它能够动态地根据预测结果和真实标签之间的差异,调整阈值,使得模型在训练时更加关注难以分类的样本。

焦点机制:通过引入焦点机制,ATFL 在处理易分类和难分类样本时,降低了易分类样本的影响力,同时增强了对难分类样本的关注。这种机制有助于提升模型的整体性能,尤其是在类别不平衡的情况下。

阈值调整:ATFL 引入了自适应阈值,能够针对每个样本计算一个合适的阈值,以决定如何加权损失。这种方式使得损失函数能够更好地反映出样本的重要性。

增强学习能力:ATFL 通过优化的损失计算方式,使得模型能够更快地学习到有价值的特征,从而提升了训练的效率和效果。

这里是对损失函数的改进,所以在代码里不用修改配置文件(yaml文件)

总结:如果你的样本量分布不平衡,就说这个ATFL针对这个,围绕这个编加了以后的优点。

如果样本比较平衡,就不提分布问题,直接说,ATFL通过降低易分类样本的影响,增强对难分类样本的关注,从而提升目标检测和分割任务中的模型性能。

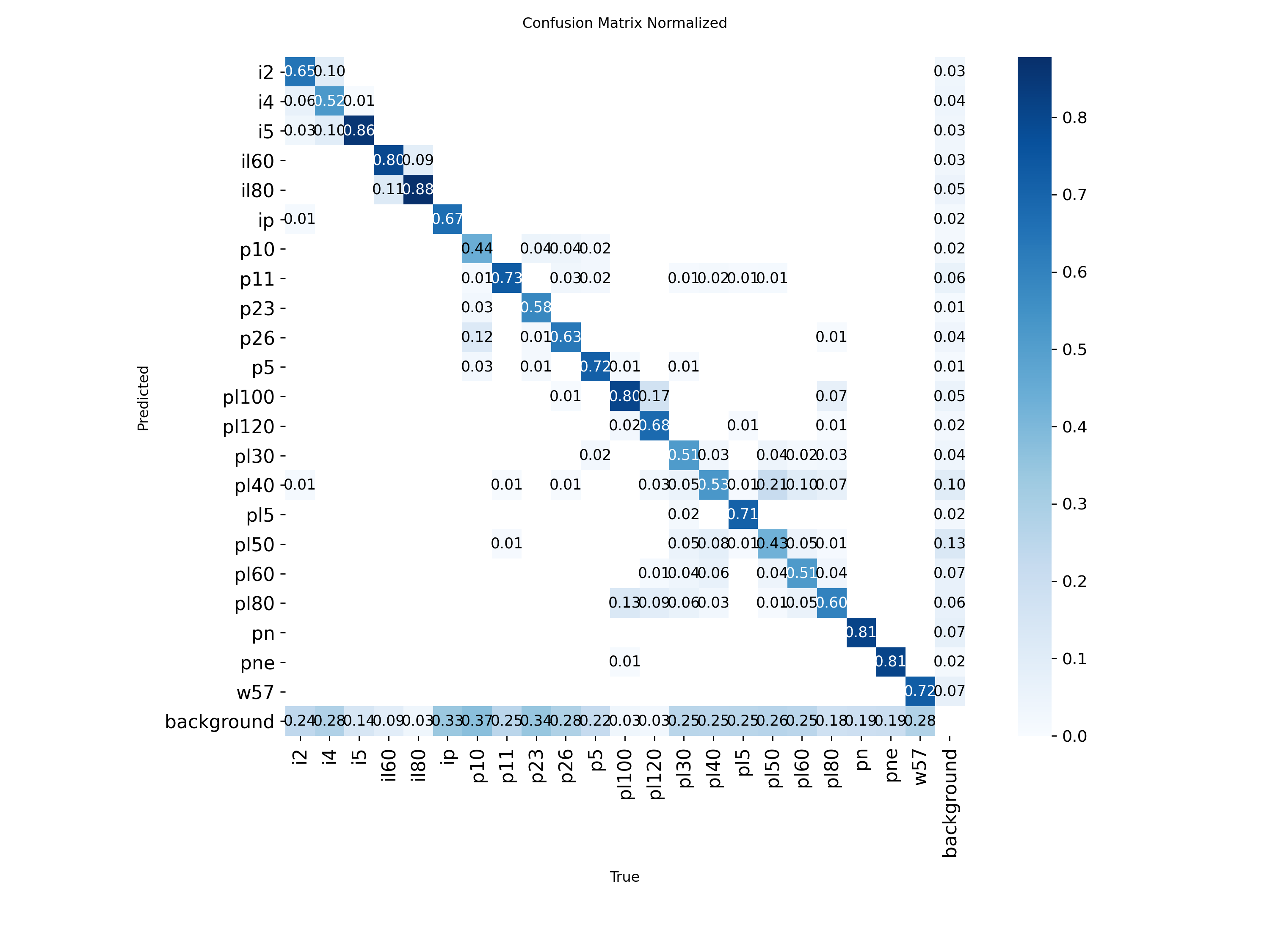

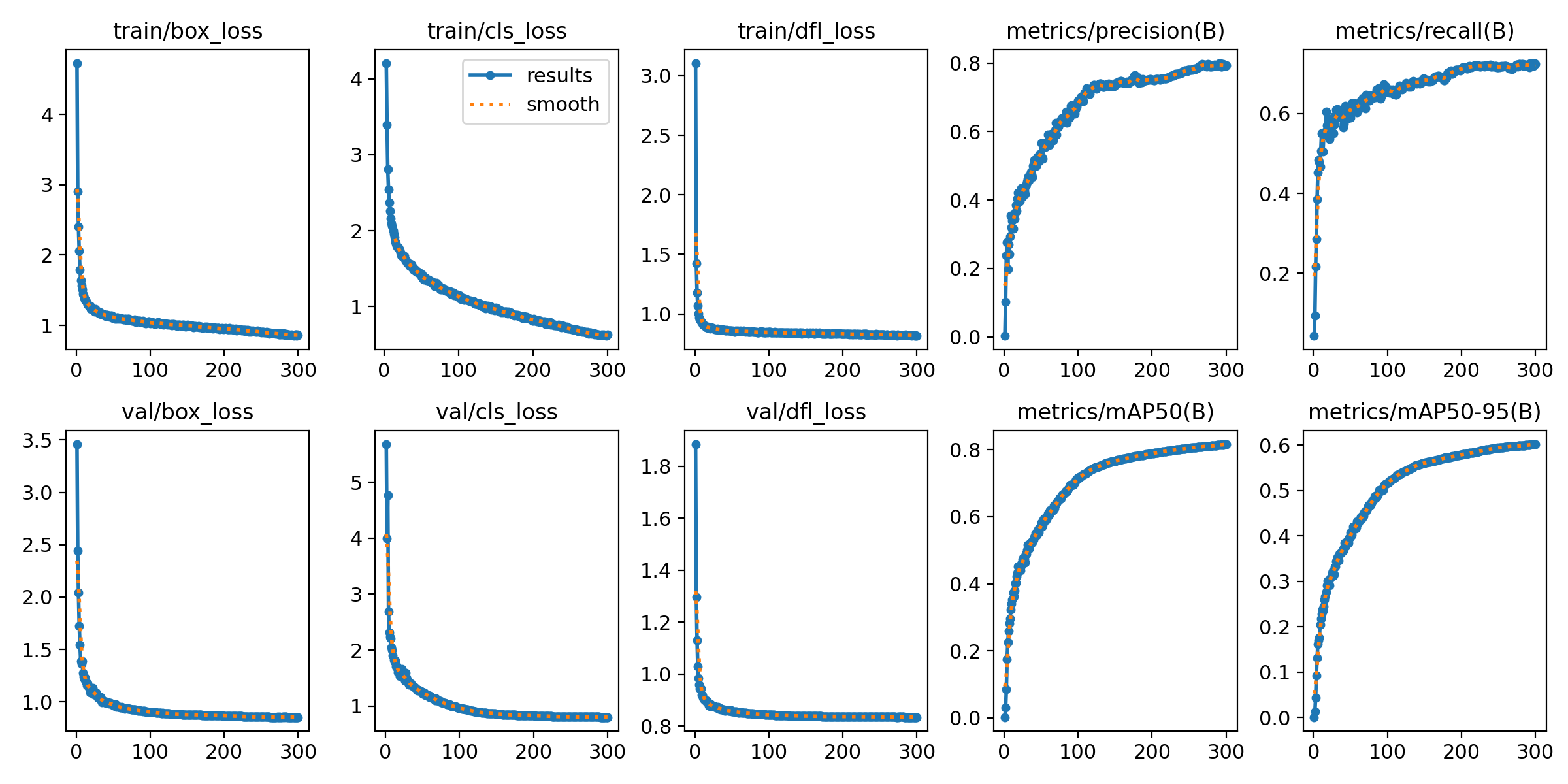

训练完模型会得到训练日志。

里面有结果图片,部分展示如下:

训练完多个模型后,可以做对比实验,通过写代码可以制作对比曲线图和柱状图,项目的最终实验效果如下:

最后基于Python的PYQT5框架,制作最终的GUI演示系统。

实现对图片,视频,摄像头等多种输入的检测。

提供两种不同的风格供选择,另外一个不用的话,直接删除就行。

第一种:

第二种:

本项目包含:

1.多模型的对比实验和图表,丰富了项目的内容。

2. 模型的优化改进,实现项目的创新。

3. 多种实验分析,拓展的项目的深度和内容量

4.实现了最终的演示系统,实现了项目的落地和应用。