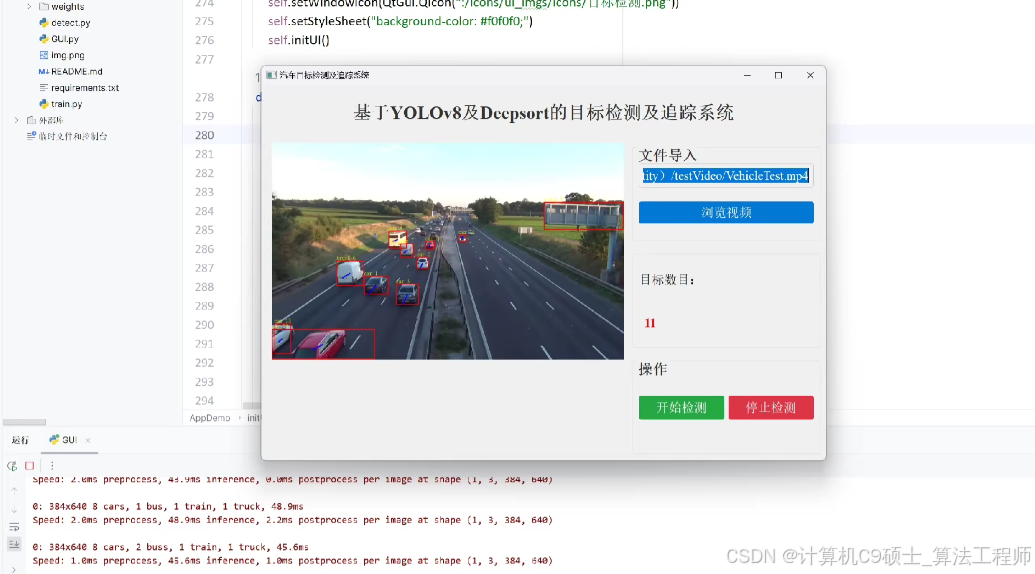

基于yolov8与deepsort的多目标检测及追踪系统

基于视频/摄像头的车辆或其他目标追踪(可自己标注数据集,训练权重来继进行追踪

好的,了解了你的需求。你希望构建一个基于YOLOv8和DeepSORT的多目标检测及追踪系统,可以用于视频或摄像头输入的目标追踪。我们将使用自定义数据集进行训练,并生成相应的权重文件来进行追踪。

项目介绍

数据准备

- 数据集: 自定义数据集(例如车辆或其他目标)。

- 标注格式: YOLO TXT格式。

- 类别:

- 根据实际需求定义类别(例如车辆、行人等)。

模型选择

- YOLOv8: 用于目标检测。

- DeepSORT: 用于目标追踪。

功能

- 数据加载: 自动从指定目录加载图像和标注文件。

- 模型训练: 使用YOLOv8进行训练。

- 模型评估: 在验证集上评估模型性能。

- 结果保存: 保存训练日志和最佳模型权重。

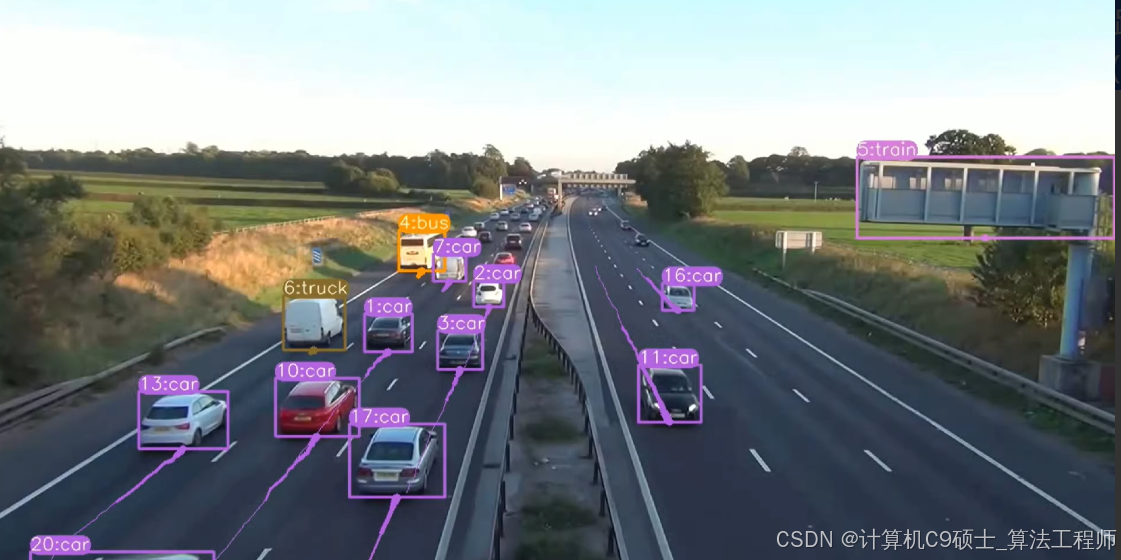

- 视频/摄像头输入: 实时目标检测与追踪。

- 可视化预测结果: 可视化预测结果以进行验证。

代码实现

首先,确保你已经安装了必要的库。你可以通过以下命令安装所需的库:

pip install ultralytics deep_sort_realtime opencv-python-headless

接下来,我们编写代码来组织数据集并训练YOLOv8模型,然后集成DeepSORT进行目标追踪。

1. 准备数据集

假设你已经有一个自定义的数据集,并且已经标注好了。数据集结构如下:

path/to/dataset/

├── train/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ └── ...

│ ├── labels/

│ │ ├── image1.txt

│ │ ├── image2.txt

│ │ └── ...

├── val/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ └── ...

│ ├── labels/

│ │ ├── image1.txt

│ │ ├── image2.jpg

│ │ └── ...

├── test/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ └── ...

│ ├── labels/

│ │ ├── image1.txt

│ │ ├── image2.jpg

│ │ └── ...

├── data.yaml

2. 训练YOLOv8模型

3. 集成DeepSORT进行目标追踪

如何使用这些代码

-

准备数据:

- 确保你的数据集格式正确,包含训练集、验证集和测试集文件夹,以及对应的标注文件。

- 示例数据结构如下:

path/to/dataset/ ├── train/ │ ├── images/ │ │ ├── image1.jpg │ │ ├── image2.jpg │ │ └── ... │ ├── labels/ │ │ ├── image1.txt │ │ ├── image2.txt │ │ └── ... ├── val/ │ ├── images/ │ │ ├── image1.jpg │ │ ├── image2.jpg │ │ └── ... │ ├── labels/ │ │ ├── image1.txt │ │ ├── image2.jpg │ │ └── ... ├── test/ │ ├── images/ │ │ ├── image1.jpg │ │ ├── image2.jpg │ │ └── ... │ ├── labels/ │ │ ├── image1.txt │ │ ├── image2.jpg │ │ └── ... ├── data.yaml

-

替换数据路径:

- 在代码中,将

'path/to/dataset'替换为你的数据集路径。

dataset_dir = 'your_dataset_directory' - 在代码中,将

-

运行训练脚本:

- 将训练部分的代码复制到一个Python脚本中,并运行该脚本。

- 确保你已经安装了所需的库:

pip install ultralytics

-

运行追踪脚本:

- 将追踪部分的代码复制到另一个Python脚本中,并运行该脚本。

- 确保你已经安装了所需的库:

pip install ultralytics deep_sort_realtime opencv-python-headless

示例:使用自定义数据集

假设你有一个新的数据集 my_multi_object_dataset,其内容如下:

my_multi_object_dataset/

├── train/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ └── ...

│ ├── labels/

│ │ ├── image1.txt

│ │ ├── image2.txt

│ │ └── ...

├── val/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ └── ...

│ ├── labels/

│ │ ├── image1.txt

│ │ ├── image2.jpg

│ │ └── ...

├── test/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ └── ...

│ ├── labels/

│ │ ├── image1.txt

│ │ ├── image2.jpg

│ │ └── ...

├── data.yaml

你可以按照以下步骤进行替换:

-

修改数据路径:

dataset_dir = 'my_multi_object_dataset' -

运行完整的训练和追踪代码:

- 将所有代码整合到两个Python脚本中,并分别运行这两个脚本。

注释说明

代码中包含了详细的注释,帮助你理解每个部分的功能。以下是关键部分的注释:

-

数据准备:

data_config: 加载现有的YAML配置文件,该文件已经包含了训练集、验证集和测试集的路径以及类别信息。

-

模型训练:

model.train: 使用YOLOv8进行训练。

-

模型评估:

model.val: 在验证集上评估模型性能。

-

视频/摄像头输入:

cv2.VideoCapture: 打开视频流(可以是摄像头或视频文件)。

-

目标检测:

model(frame): 使用YOLOv8进行目标检测。

-

DeepSORT追踪:

deepsort.update_tracks: 使用DeepSORT进行目标追踪。

-

可视化预测结果:

cv2.rectangle: 绘制检测框。cv2.putText: 显示类别标签和追踪ID。

结果

运行代码后,你将得到以下结果:

-

控制台输出:

- 训练过程中每个epoch的日志信息。

- 验证集上的评价指标(如mAP)。

-

文件输出:

runs/train/multi_object_detection/weights/best.pt: 最佳模型权重。runs/val/exp/results.txt: 验证结果。

-

实时显示:

- 视频或摄像头输入的画面中带有检测框和追踪ID的图像。

希望这些详细的信息和代码能够帮助你顺利实施和优化你的多目标检测及追踪系统。如果你有任何进一步的问题或需要更多帮助,请随时提问!

运行步骤总结

-

安装依赖项:

pip install ultralytics deep_sort_realtime opencv-python-headless -

准备数据集:

- 确保数据集路径正确,并且包含训练集、验证集和测试集文件夹,以及对应的标注文件。

-

运行训练脚本:

python train_script.py -

运行追踪脚本:

python tracking_script.py -

查看结果:

- 实时显示带有检测框和追踪ID的视频或摄像头画面。

希望这些详细的指导和代码示例能帮助你成功实现和优化你的多目标检测及追踪系统。如果有任何问题或需要进一步的帮助,请随时告诉我!